Sie kennen das Versprechen. KI wird die Fertigung revolutionieren — vorausschauende Wartung, automatisierte Qualitätskontrolle, Echtzeitoptimierung. Die Technologie existiert. Die Modelle sind verfügbar. Warum also scheitern 95 % der KI-Projekte in der Fertigung daran, messbaren ROI zu liefern?

Nach Jahren der Zusammenarbeit mit Herstellern in Deutschland und Europa kann ich mit Sicherheit sagen: Das Problem ist nicht das Modell. Das Problem ist alles rund um das Modell.

Die Umgebung wurde nicht für KI gebaut

Fertigungssysteme wurden für eines entwickelt: Stabilität. Deterministische Maschinensteuerung. Isolierte Prozesse, die zuverlässig laufen, Schicht für Schicht. Sie wurden nie mit Konnektivität, strukturierten Daten oder Echtzeitanalysen im Sinn gebaut.

Was man auf einem typischen Shopfloor tatsächlich vorfindet:

- Inkompatible Protokolle zwischen Maschinen verschiedener Jahrzehnte

- Legacy-SPSen, die proprietäre Sprachen sprechen

- Isolierte MES-Systeme mit inkonsistenten Datenformaten

- Fehlende Zeitstempel, nicht synchronisierte Uhren zwischen Systemen

- Herstellergebundene APIs, deren Integration Monate dauert

Jede Maschine spricht ihre eigene Sprache. Jede Produktionsstation erzeugt Daten auf ihre eigene Art. Die Integration dieser Systeme erfordert in der Regel das Schreiben individueller Konnektoren, Reverse Engineering von Maschinenschnittstellen oder den Umgang mit herstellerspezifischen APIs. Das macht den Datenzugang langsam, fragil und teuer.

Die Datenqualitätskrise

Selbst wenn Daten zugänglich sind, sind sie selten nutzbar. Sensoren messen physikalische Signale, keinen Prozesskontext. Ein Temperaturwert ohne Kenntnis des Betriebsmodus, der Materialcharge oder des Werkzeugzustands ist nur Rauschen, das wie Daten aussieht.

Die Probleme summieren sich:

- Sensordrift — Signale verändern sich über die Zeit, ohne dass es jemand verfolgt

- Zeitliche Fehlausrichtung — SPSen, Testmaschinen und MES-Plattformen laufen auf verschiedenen Uhren

- Fehlende Labels — Ausfälle sind selten, Ursachen unklar, Qualitätsergebnisse verzögert

- Kontextlücken — dasselbe Signal bedeutet während des Anlaufs etwas anderes als im Normalbetrieb

KI-Modelle sind auf saubere, synchronisierte und kontextualisierte Daten angewiesen. Die meisten Fabriken können dies ohne erheblichen Vorverarbeitungsaufwand schlicht nicht liefern.

Jeder Anwendungsfall wird zum eigenen IT-Projekt

Hier bricht die Wirtschaftlichkeit zusammen. Für jeden KI-Anwendungsfall müssen Teams aufbauen:

- Eine neue Datenpipeline

- Einen neuen Vorverarbeitungs-Workflow

- Einen neuen Deployment-Mechanismus

- Neue Integrationslogik mit MES oder Operator-Dashboards

Das bedeutet, dass jeder Anwendungsfall im Grunde ein maßgeschneidertes IT-Projekt ist. Kein Wunder, dass die meisten Unternehmen nie über isolierte Pilotprojekte hinauskommen — die Architektur skaliert einfach nicht.

„95 % der KI-Pilotprojekte oder Enterprise-KI-Projekte scheitern daran, messbaren ROI oder signifikanten geschäftlichen Nutzen zu liefern. Nur etwa 5 % dieser Projekte skalieren erfolgreich und erzeugen messbaren Wert."

— MIT, „The GenAI Divide: State of AI in Business 2025"

Der menschliche Faktor, über den niemand spricht

Die Fertigung hat einzigartige Rahmenbedingungen, mit denen Consumer-KI nie zu tun hat: hohe Verfügbarkeitsanforderungen, strenge Sicherheitsvorschriften, vollständige Rückverfolgbarkeit und die Notwendigkeit der Bedieneraufsicht. KI kann Entscheidungen nicht einfach „übernehmen". Sie muss Menschen unterstützen, nicht ersetzen.

Aber in vielen KI-Projekten wird diese Anforderung zu spät — oder gar nicht — berücksichtigt. Das Ergebnis? Misstrauen und Widerstand auf dem Shopfloor. Bediener, die nicht verstehen, warum ein System sich auf eine bestimmte Weise verhält, werden Wege finden, es zu umgehen.

Was tatsächlich funktioniert

Die Lösung sind nicht bessere Algorithmen. Es ist ein besseres Fundament.

Bei RockQ haben wir eine No-Code-Plattform mit einem integrierten Machine Learning Studio entwickelt, die die größten Blocker zuerst angreift:

1. Integrationskomplexität beseitigen

Unsere Plattform verbindet jede Maschine, SPS oder jedes IT-System, ohne individuelle Treiber zu schreiben. OPC UA, MQTT, Legacy-Controller, Testmaschinen, MES-Datenbanken — alles wird in einer einheitlichen Datenschicht normalisiert. Das eliminiert Monate an Konnektivitätsarbeit, die typischerweise jedem KI-Vorhaben vorausgeht.

2. Daten an der Quelle korrigieren

Das ML Studio ermöglicht es Prozessingenieuren — den Menschen, die die Maschinen tatsächlich verstehen — Daten visuell zu bereinigen, zu labeln und vorzubereiten. Sie entfernen Rauschen, gleichen Zeitstempel ab und fügen Prozesskontext hinzu. Das Modell lernt endlich aus der korrekten Darstellung des Prozesses, nicht aus chaotischen Rohdaten.

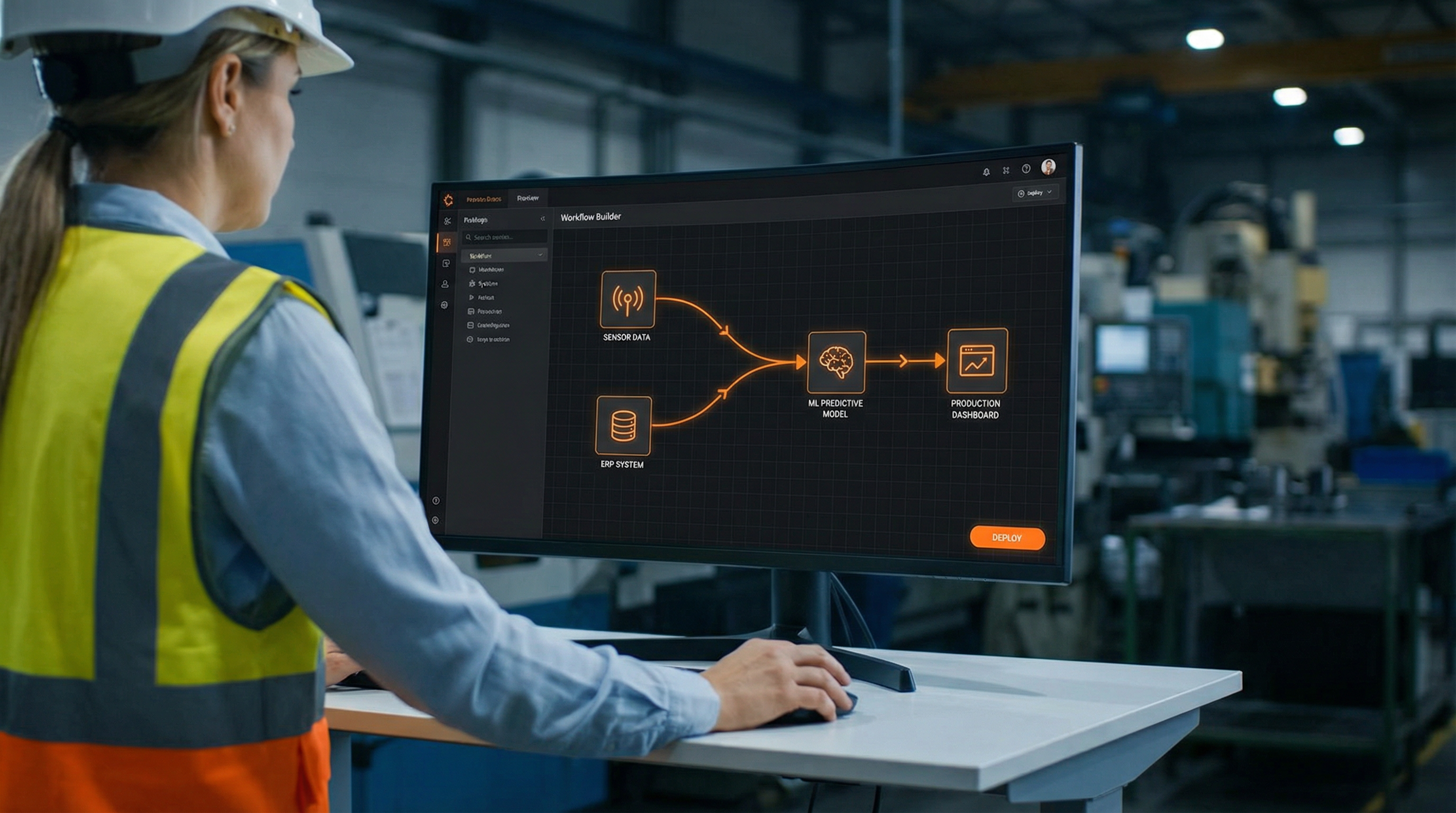

3. Training und Deployment in einer Umgebung

Das Modelltraining findet innerhalb derselben Plattform statt. AutoML oder individuelle Trainingspipelines laufen, ohne Daten zu exportieren oder Tools zu wechseln. Die Plattform bewertet die Performance, wählt das beste Modell aus und verpackt es für das Deployment — alles in einem Arbeitsablauf.

4. KI operativ machen, nicht experimentell

Deployment ist kein separates Engineering-Projekt. Mit Drag-and-Drop-Logikbausteinen werden Modelle mit Echtzeitdaten, Dashboards, Alarmen und Operator-Workflows verbunden. Der gesamte Pfad — vom Signal über die Vorhersage bis zur Aktion — wird transparent. Bediener behalten die volle Kontrolle.

5. Skalieren ohne Neuaufbau

Da alle Anwendungsfälle dieselbe Infrastruktur teilen, müssen Unternehmen Pipelines nicht für jedes neue Projekt neu aufbauen. Konnektoren, Logikbausteine und Datenquellen werden im gesamten Werk wiederverwendet. So wird KI von einer Sammlung isolierter PoCs zu einer skalierbaren Fähigkeit.

Das Fazit

KI in der Fertigung scheitert nicht, weil die Technologie nicht bereit ist. Sie scheitert, weil die Umgebung nicht bereit ist. Beheben Sie den Datenzugang, beheben Sie die Datenqualität, beheben Sie die Integration, beheben Sie das Deployment — und selbst einfache Modelle liefern konsistenten ROI.

Die Frage ist nicht, ob KI in der Fertigung funktioniert. Die Frage ist, ob Ihre Fabrik dafür bereit ist.