Betreten Sie einen Shopfloor, der seit mehr als zwei Jahrzehnten in Betrieb ist, und Sie finden eine Geschichtsstunde der industriellen Automatisierung. Eine Siemens S7-300 aus den späten Neunzigern, die über MPI kommuniziert. Ein Fanuc-Robotercontroller, der sein eigenes proprietäres Protokoll spricht. Ein modernes Beckhoff-System auf EtherCAT. Ein MES auf einer Oracle-Datenbank. Ein Historian, der über OPC DA sammelt. Ein Qualitätssystem, das jede Schicht CSV-Dateien exportiert.

Das ist nicht ungewöhnlich. Das ist normal. Ein mittelständisches Fertigungswerk arbeitet typischerweise mit 30 bis 50 verschiedenen Datenformaten und Protokollen, angesammelt über Jahre inkrementeller Ausrüstungskäufe, Anbieterauswahlen und Systemupgrades. Jedes System war bei der Installation sinnvoll. Zusammen bilden sie eine Datenlandschaft, die sich jedem Versuch einer einheitlichen Analyse widersetzt.

Warum Datenfragmentierung KI bereits vor dem Start killt

KI-Modelle interessieren sich nicht für Protokolle. Sie brauchen strukturierte, zeitlich ausgerichtete, semantisch konsistente Daten. Aber wenn ein Vibrationssignal von einem OPC-UA-Server in Millisekundenauflösung kommt, Temperaturdaten über MQTT in Fünf-Sekunden-Intervallen eintreffen und Qualitätsergebnisse in einer relationalen Datenbank mit Chargen-Granularität protokolliert werden, ist der Vorverarbeitungsaufwand enorm. Allein drei Signale in dasselbe Zeitreihenformat zu bringen, kann Wochen an Engineering kosten.

Die Fragmentierung erzeugt sich verstärkende Probleme:

- Semantische Inkonsistenz — dieselbe physikalische Messung in verschiedenen Systemen unterschiedlich benannt („spindle_temp“ vs. „T_SP1“ vs. „temperature_main_spindle“)

- Zeitliche Fehlausrichtung — Systeme auf nicht synchronisierten Uhren, was Ereigniskorrelation unzuverlässig macht

- Zugriffskomplexität — jede Datenquelle erfordert andere Zugangsdaten, Treiber und Abfragemethoden

- Schema-Drift — Firmware-Updates und Konfigurationsänderungen verändern Datenstrukturen ohne Vorwarnung

Jedes KI-Projekt, das diese Realitäten ignoriert, verbringt seine ersten Monate im Kampf gegen die Dateninfrastruktur statt im Training von Modellen. Die technischen Schulden akkumulieren sich unbemerkt, bis sie zum dominierenden Kostenfaktor jeder Initiative werden.

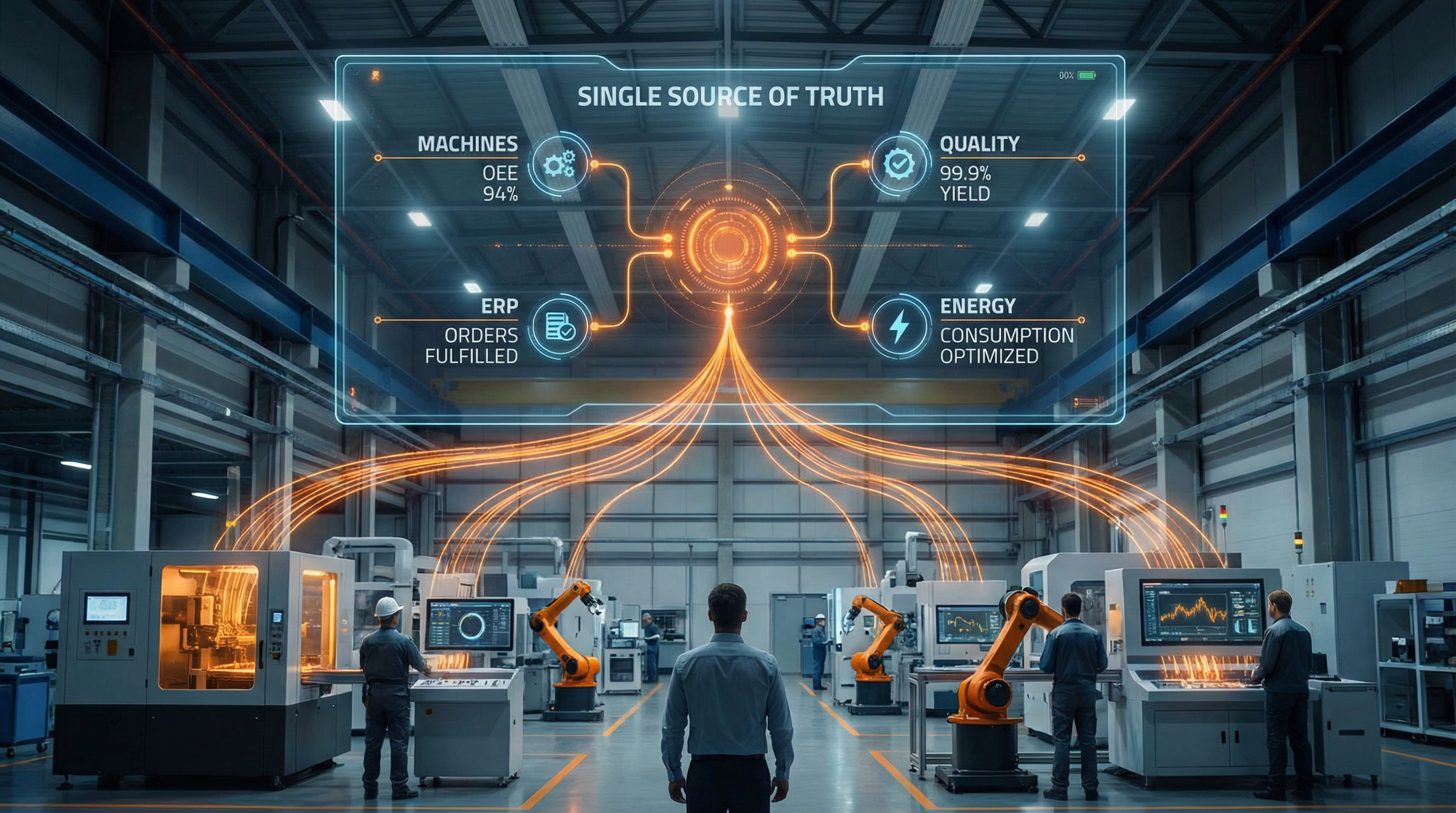

Die einheitliche Wahrheit aufbauen

Eine einheitliche Datenschicht bedeutet nicht, bestehende Systeme zu ersetzen. Sie bedeutet, eine Abstraktionsschicht darüber zu legen, die Daten aus jeder Quelle in ein konsistentes Modell normalisiert, ausrichtet und kontextualisiert. Bei RockQ nimmt diese Schicht Daten von OPC UA, MQTT, Modbus, S7, REST-APIs, Datenbanken und dateibasierten Quellen auf — alles über Konfiguration, nicht Code. Jedes Signal erhält einen kanonischen Namen, eine Einheit, einen auf eine gemeinsame Uhr ausgerichteten Zeitstempel und Prozesskontext, der es aussagekräftig macht.

Der Effekt ist sofort spürbar. Wenn ein Prozessingenieur Spindellastmuster über drei verschiedene CNC-Maschinen von drei verschiedenen Herstellern vergleichen will, ist die Abfrage identisch. Wenn ein KI-Modell Vibrations-, Temperatur- und Werkzeugverschleißdaten für einen kombinierten Gesundheits-Score benötigt, liegen alle drei Signale bereits im selben Format, derselben Auflösung, derselben Zeitbasis vor. Der Ingenieur konzentriert sich auf die Analyse, nicht auf die Leitungen.

Von der einzelnen Maschine zur werksübergreifenden Intelligenz

Die wahre Stärke einer einheitlichen Datenschicht zeigt sich in der Skalierung. Wenn jede Maschine über jede Linie hinweg dieselbe Datensprache spricht, werden Analysen, die vorher unmöglich waren, selbstverständlich. OEE über Werke hinweg vergleichen. Energieeffizienz nach Produkttyp benchmarken. Herausfinden, warum dasselbe Teil auf Linie 3 die Qualitätsprüfung nicht besteht, aber auf Linie 7 schon. Diese Erkenntnisse erfordern Daten, die nicht nur zugänglich, sondern vergleichbar sind — und genau das liefert Normalisierung.

Hersteller, die in eine einheitliche Datenschicht investieren, lösen nicht nur den heutigen KI-Anwendungsfall. Sie bauen das Fundament für jeden zukünftigen. Jede neue angeschlossene Maschine, jedes neue normalisierte Signal fügt einem Asset Wert hinzu, das mit der Zeit immer wertvoller wird. Die Alternative — individuelle Pipelines für jedes Projekt zu bauen — ist eine Strategie, die abnehmende Erträge garantiert.