Hier ein Muster, das sich in fast jedem Fertigungsunternehmen wiederholt, das KI einsetzen will. Der erste Anwendungsfall — etwa Predictive Maintenance an einer kritischen CNC-Linie — dauert acht Monate. Das Team baut individuelle Konnektoren zur SPS, schreibt ETL-Skripte für den Historian, verhandelt API-Zugang mit dem MES-Anbieter und verdrahtet ein Dashboard von Hand. Es funktioniert. Die Geschäftsführung ist beeindruckt.

Dann kommt Anwendungsfall Nummer zwei: Energieoptimierung an derselben Linie. Andere Signale, aber dieselben Maschinen. Man würde erwarten, dass 80 % der Infrastruktur übernommen werden können. Stattdessen stellt das Team fest, dass die Konnektoren für spezifische Datenpunkte gebaut wurden, die Pipeline ein festes Schema voraussetzte und das Dashboard fest codiert war. Sie fangen von vorne an. Wieder.

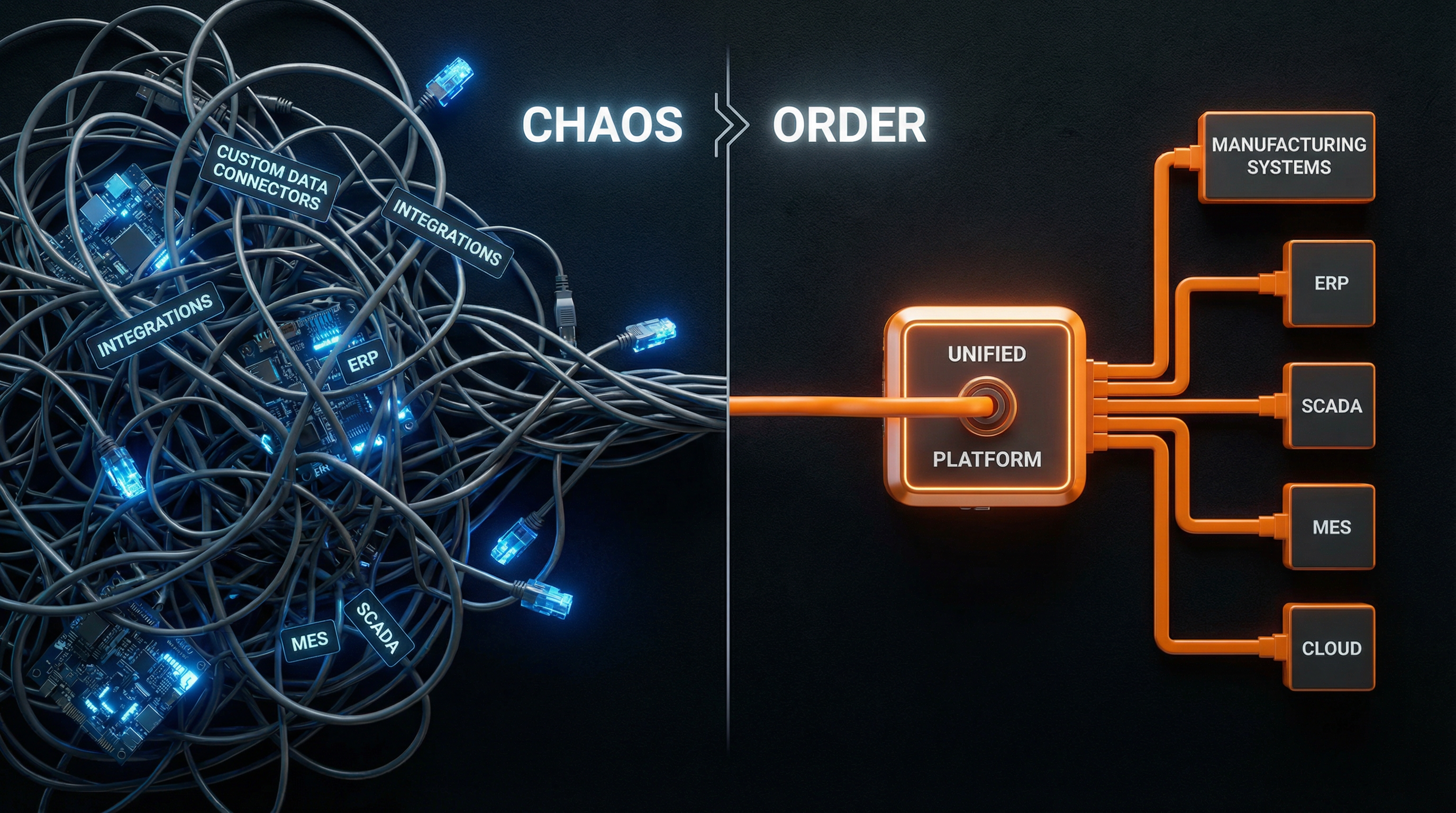

Die versteckten Kosten von Punkt-zu-Punkt-Integration

Das nennen wir die Integrationssteuer — die kumulierten Kosten für den Neuaufbau von Konnektivität, Datenpipelines und Deployment-Logik für jeden neuen KI-Anwendungsfall. Es ist keine einmalige Gebühr. Sie summiert sich. Jedes neue Projekt erbt die Komplexität des vorherigen, ohne dessen Infrastruktur zu übernehmen.

Die Zahlen sind ernüchternd. In einer typischen KI-Initiative in der Fertigung verschlingen Integration und Data Engineering 60–70 % des gesamten Projektbudgets. Das eigentliche Modell — der Teil, den alle für „die KI" halten — macht nur einen Bruchteil der Arbeit aus. Dennoch finanzieren Unternehmen weiterhin Projekte, als wäre das Modell der Engpass.

Die Symptome sind vorhersehbar:

- Individuelle Konnektoren, die für jedes Projekt von Grund auf neu gebaut werden

- Datenpipelines, die brechen, wenn ein Maschinen-Firmware-Update eine Registeradresse ändert

- Deployment-Skripte, die an eine bestimmte Serverkonfiguration gebunden sind

- Dashboards, die nicht wiederverwendet werden können, weil sie für einen Anwendungsfall fest codiert sind

- IT-Teams, die dünn aufgestellt sind und einen wachsenden Zoo von Einzellösungen warten

Warum Einzellösungen das Problem verschärfen

Viele Hersteller versuchen, dies durch den Kauf spezialisierter Einzellösungen zu lösen — ein Anbieter für Vibrationsüberwachung, ein anderer für visuelle Qualitätsprüfung, ein dritter für Energieanalytik. Jede bringt eigene Konnektoren, ein eigenes Datenmodell, ein eigenes Dashboard mit. Die Integrationssteuer sinkt nicht. Sie multipliziert sich über die Anbieter hinweg.

Schlimmer noch: Diese Systeme kommunizieren selten miteinander. Die Vibrationsdaten aus dem Predictive-Maintenance-Tool können das Qualitätsmodell nicht informieren. Die Energieverbrauchsmuster lassen sich nicht mit Durchsatzkennzahlen korrelieren. Jede Erkenntnis bleibt in ihrem eigenen Silo gefangen, und die bereichsübergreifende Intelligenz, die tatsächlich operative Verbesserungen antreibt, bleibt unerreichbar.

Die Plattform-Alternative: Einmal bauen, vielfach einsetzen

Die Integrationssteuer verschwindet, wenn Konnektivität als gemeinsame Infrastruktur behandelt wird statt als Projektausgabe. Bei RockQ wird jede Maschinenanbindung, Datentransformation und Deployment-Pipeline einmal gebaut und über alle Anwendungsfälle hinweg wiederverwendet. Ein Konnektor zu einer Siemens S7-1500 SPS bedient Predictive Maintenance, Qualitätsanalytik und Energiemonitoring gleichzeitig. Eine normalisierte Datenschicht bedeutet, dass neue Modelle auf jedes Signal von jeder Maschine zugreifen können, ohne die Infrastruktur neu aufzubauen.

Genau das macht KI von einem Experiment zu einer operativen Fähigkeit. Der erste Anwendungsfall dauert vielleicht vier Wochen. Der zweite zwei. Beim fünften deployen Teams in Tagen — weil das Fundament bereits existiert. Die Integrationssteuer sinkt auf nahezu null, und die Grenzkosten jedes neuen Anwendungsfalls werden zu den Kosten der KI-Logik selbst, nicht der sie umgebenden Infrastruktur.

Hersteller, die Integration als strategische Investition behandeln statt als Projektkosten, bewegen sich nicht nur schneller. Sie bauen einen sich verstärkenden Vorteil auf: Jeder Anwendungsfall macht den nächsten einfacher, günstiger und wertvoller.